Daniel Martí Pellón anunciaba el pasado mes de enero su despedida de su blog ComuniSfera – Ojo que también dispone del blog Comunicación e Imagen situado en La Coctelera – después de cinco años en activo. Aunque Daniel siempre deja la puerta abierta al retorno, lo cierto es que su autor argumentaba que buscaba nuevos espacios de la comunicación con su “comunidad” con la firme convicción de desplazarse allí donde se encontrase. En el texto donde hacía recopilación de los hechos más destacados durante los cinco años que ha mantenido su actividad bloguera, podíamos deducir un cierto regusto amargo y un poco frustrado, de lo que debería haber sido el blog y lo que no ha llegado a ser.

Daniel Martí Pellón anunciaba el pasado mes de enero su despedida de su blog ComuniSfera – Ojo que también dispone del blog Comunicación e Imagen situado en La Coctelera – después de cinco años en activo. Aunque Daniel siempre deja la puerta abierta al retorno, lo cierto es que su autor argumentaba que buscaba nuevos espacios de la comunicación con su “comunidad” con la firme convicción de desplazarse allí donde se encontrase. En el texto donde hacía recopilación de los hechos más destacados durante los cinco años que ha mantenido su actividad bloguera, podíamos deducir un cierto regusto amargo y un poco frustrado, de lo que debería haber sido el blog y lo que no ha llegado a ser.

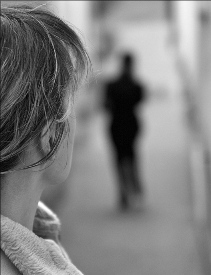

Desde que leí el texto, no he podido dejar de reflexionar sobre el adiós que he vivido de muchos bloguers. Algunos que me impactaron especialmente, pero siendo plenamente consciente de que esto es precisamente ley de vida. No podemos negar que cinco años es mucho tiempo, un marco temporal excepcional que muy pocos confiábamos en sobrepasar, puede que ni imaginábamos, cuando comenzamos a postear. Este año, dentro de este blog, también celebraremos nuestro quinto aniversario y los razonamientos evocados por Daniel también me hacen reconsiderar el camino realizado aunque sea de forma anticipada.

No hace falta indicaros que la reflexión de una persona con su espacio de publicación digital no es algo nuevo para mi, ya que he dejado muchos textos tratando de reflejar la experiencia que he sentido a la hora de mantener este blog. Hoy estoy hablando de textos como Mientras escribo, Punto y aparte, El síndrome del blogger quemado o Achaques de bloguer, donde reflejo con mejor o peor fortuna cierta frustración de aquel que se encuentra en la encrucijada, altos en el camino que nos invitan ha abandonarlo definitivamente, pero que finalmente se resuelven por la necesidad de comunicar, razonar y aprender.

Por otro lado, qué duda cabe que la experiencia es un grado. Si en nuestro tercer aniversario, os confesábamos que seguíamos adelante por vosotros, por los que día a día os agregáis a nuestro feed, por aquellos que en silencio nos seguís tímidamente y por las ocasiones que os acercáis a nosotros y nos confesáis que lo que hacemos, al menos, lo hacemos bien; este año me proponía ir a ciegas, sin fijarme ningún objetivo concreto aunque siendo consciente de que cada vez la tarea es más ardua mientras otras obligaciones se imponen frente a los entretenimientos que uno pudiese disfrutar.

Otro de los factores decisivos en el desgaste de los blogs profesionales personales, se debe a que la Blogosfera ha hecho madurar a los medios de comunicación en Internet, forzándoles a abrirse, a tratar de construir sus comunidades, a mostrarse ágiles cuando salta la noticia. El seguimiento de la actualidad les impone un proceso de actualización constante, por otro lado, las reflexiones, y no necesariamente irreflexiones, se multiplican en múltiples espacios, llevándote a la conclusión que tus aportaciones son más bien pocas, mientras que los espacios comunicativos, sociales si se quiere, se multiplican dejando el blog como un reducto de aquel tiempo pasado que fue mejor.

Sí, hoy más que nunca, los bloguers pueden sentir cómo su dedicación está cada día más injustificada. Mientras las audiencias no crecen, desplazándose hacia las redes sociales, robando tiempo de navegación, a la vez que los comentarios desaparecen, olvidándose un poco de lo que fue La Conversación; los bloguers individuales que mantienen sus blogs en búsqueda de nuevos espacios de reflexión de forma independiente pueden sentirse un poco desvalidos, considerando ¿dónde está mi gente?

Puede ser que el mayor pecado de los blogs haya sido no haber sabido fijar la red social que se entrelaza en el día a día, como han sabido realizar otros servicios de la Web 2.0 y es posible que, hoy en día, ésta sea la mayor de sus flaquezas, el no haber sabido representar las redes sociales que los bloguers construían.

5 comentarios

Parece ser que últimamente Google, aunque también el resto de compañías con los buscadores más importantes Yahoo y Microsoft, disponen de más poder a la hora de desarrollar estándares para nuestras páginas web que el mismísimo W3C. Por supuesto que seguir las recomendaciones del W3C tampoco es que hayan sido seguidas a pies juntillas por las grandes empresas informáticas. Sin ir más lejos, Microsoft no ha sido del gusto de seguir los dictados del consorcio y bien conocidos son los quebraderos de cabeza que los diseñadores web han sufrido a la hora de desarrollar páginas web porque los chicos de Redmond no se han arrugado a la hora de saltárselos en el desarrollo de su Internet Explorer.

Parece ser que últimamente Google, aunque también el resto de compañías con los buscadores más importantes Yahoo y Microsoft, disponen de más poder a la hora de desarrollar estándares para nuestras páginas web que el mismísimo W3C. Por supuesto que seguir las recomendaciones del W3C tampoco es que hayan sido seguidas a pies juntillas por las grandes empresas informáticas. Sin ir más lejos, Microsoft no ha sido del gusto de seguir los dictados del consorcio y bien conocidos son los quebraderos de cabeza que los diseñadores web han sufrido a la hora de desarrollar páginas web porque los chicos de Redmond no se han arrugado a la hora de saltárselos en el desarrollo de su Internet Explorer. Todo parece indicar que este 2009 está siendo especialmente problemático para Google a nivel de gestión. Si finalizando enero cometía

Todo parece indicar que este 2009 está siendo especialmente problemático para Google a nivel de gestión. Si finalizando enero cometía